Scrapy vs Beautiful Soup for Web Scraping

The most famous Python libraries for web scraping are Scrapy and Beautiful Soup, but each library comes with its pros and cons. Nothing is perfect in this world. Sometimes one library surpasses the other and vice versa. In this article, we will analyze both libraries with different aspects so the readers may have a better

The most famous Python libraries for web scraping are Scrapy and Beautiful Soup, but each library comes with its pros and cons. Nothing is perfect in this world. Sometimes one library surpasses the other and vice versa. In this article, we will analyze both libraries with different aspects so the readers may have a better idea when to use what. We will start from the core module implementation, and after that, we will also see the working mechanisms of both libraries. Finally, we will build the conclusion by diving into the differences of each tool. Let’s take a start by digging further into Scrapy,

Scrapy

Scrapy is an open-source collaborative framework for extracting data from the websites of our choice. It is one of the most powerful Python libraries out there because of its high-speed performance. One of the key advantages of using Scrapy is that it uses a non-blocking mechanism while sending requests to the users because it is built on top of a twisted, asynchronous framework.

The asynchronous requests are much more beneficial than synchronous requests because they follow non-blocking I/O calls to the server.

Some of the salient features of Scrapy are,

- The built-in support allows Scrapy to extract data from HTML sources using XPath expressions and CSS expressions.

- It has multi-platform support, making it portable (written in Python and runs on Mac, Windows, Linux, and BSD).

- This library is easily extensible.

- It can extract the websites 20 times faster than other tools making it the most robust scraping library.

- It is very light and hence consumes less memory and CPU usage.

- It can further be optimized to make robust and flexible applications with a bunch of amazing functionalities.

- Documentation is not that good and beginner-friendly, but overall has good community support for developers.

Beautiful Soup

Just like its name, it is a beautiful tool for web scrapers because of its core functionalities. It quickly extracts the data from the web page according to the choice of the programmer. This tool is convenient when it comes to pulling the data from HTML and XML files. But the problem with Beautiful Soup is that it doesn’t work independently. It relies on other modules to get the work done.

Some of the dependencies of Beautiful Soup are,

- It requires a library to make a request to the website because it is unable to make a request to the particular server. To resolve this issue, it is dependent on the two most popular libraries called Requests or urllib2. These libraries make it possible to make the request to the server.

- It also requires the External Parser to parse the downloaded data that is in the form of HTML, XML. Some of the most famous parsers are html.parser, HTML5lib, lxml’s HTML parser.

The benefits of using Beautiful Soup are,

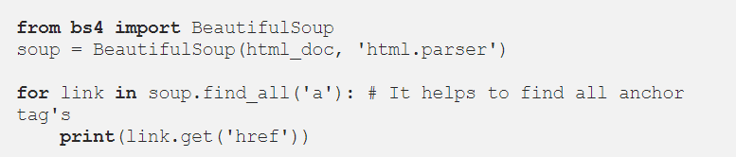

- It is straightforward to learn and master. To have a better understanding of how it can be used to extract data from the website, let’s consider the below example

Figure1: Example Using Beautiful Soup

- As can be seen in the above code, we are using html.parser to parse the content of the html_doc. Its ease and simplicity are some of the most substantial reasons for developers to use Beautiful Soup.

- It has great comprehensive documentation making it easier to learn and implement.

- The vast community support helps to figure out and resolve the issues quickly and easily.

Choosing the Best Library: Beautiful Soup or Scrapy?

Every library has its pros and cons, so various key factors are involved in choosing the perfect library to get the job done. This section will discuss the selection criteria needed to select the best library for our project. Some key factors that play a significant part are,

Extensibility

Scrapy: It has a well-defined architecture to customize the middleware so that the custom functionalities can be added easily. It makes our project to be more robust and flexible.

Project migration from one to another becomes very easy in the case of using Scrapy. So Scrapy is very convenient while handling large projects.

If the project needs proxies, data pipelines, etc., Scrapy would be the best choice.

Beautiful Soup: It is pretty amazing for small and less complex projects because it keeps the code simple and flexible.

It is mainly recommended for beginners to learn things quickly and perform web scraping operations.

Performance

Scrapy: By making use of asynchronous system calls, it can do things quickly. It has an outstanding performance among all other libraries out there.

Beautiful Soup: Beautiful Soup’s performance is a little bit slow, but it can use the Multithreading concept to overcome this issue. However, the programmer needs to understand the concept of multithreading to implement it effectively. It may be the cause of the downsizing of Beautiful Soup.

EcoSystem

Scrapy: We can use proxies and VPNs to automate the task because of its good ecosystem. It can be beneficial for handling complex projects.

If you are looking for amazing proxy services, don’t forget to look at ProxyScrape residential and premium proxies. Do you need good proxies for your webscraping projects? Look no further; go to ProxyScrape for more details.

Beautiful Soup: Due to a large number of dependencies, this library might not be used in complex projects.

Explained above are the three common factors for the right selection among Scrapy and Beautiful Soup.

Conclusion on Beautiful Soup vs. Scrapy

In this article, we have discussed Scrapy and Beautiful Soup in detail. We have seen almost everything about the most commonly used web scraping libraries in a detailed fashion. Let’s wrap up below what we have discussed so far,

Scrapy would be the best choice if dealing with complex scraping operations that require high speed with low power consumption.

Beautiful Soup would be the best choice for those who are new to programming and want to work with the best scraping projects. It is easy to learn and allows you to work with projects up to a certain level of complexity.

The two Python web scraping libraries are made to do different tasks. Beautiful Soup is best for parsing HTML and extracting the data, while Scrapy is the best tool for downloading HTML, processing data, and saving it in the desired format.

I hope this article helps you choose the best library among Scrapy and Beautiful Soup for your web scraping projects.